C’est ce que l’on peut conclure du document intitulé Trending Review Guidelines, qui répertorie les lignes directrices de l’évaluation des tendances observées par l’algorithme de Facebook, publié aujourd’hui par le quotidien The Guardian.

Facebook compte énormément sur l’intervention d’une équipe éditoriale afin de déterminer ce qui mérite d’être injecté dans la liste des contenus populaires.

Comme le résume l’article en question par des propos qui font échos à la position exprimée par notre collègue François Dominic Laramée dans son article d’aujourd’hui, Facebook repose sa stratégie médiatique sur des valeurs traditionnelles liées au monde de l’information : le réseau social à essentiellement qu’une ligne éditoriale.

Le document indique que Facebook compte énormément sur l’intervention d’une petite équipe éditoriale afin de déterminer ce qui mérite d’être injecté dans la liste de Trending Topics, les contenus populaires affichés sur le profil d’un utilisateur dont l’interface est configurée en anglais.

Alors que cette liste était autrefois entièrement générée par son algorithme (selon divers facteurs dont l’interaction générée par une nouvelle, les pages auxquelles vous êtes abonnés, votre situation géographique et vos préférences), Facebook aurait révisé cette approche purement algorithmique en 2014 après avoir été la cible de critiques déplorant l’absence de couverture des manifestations de Ferguson.

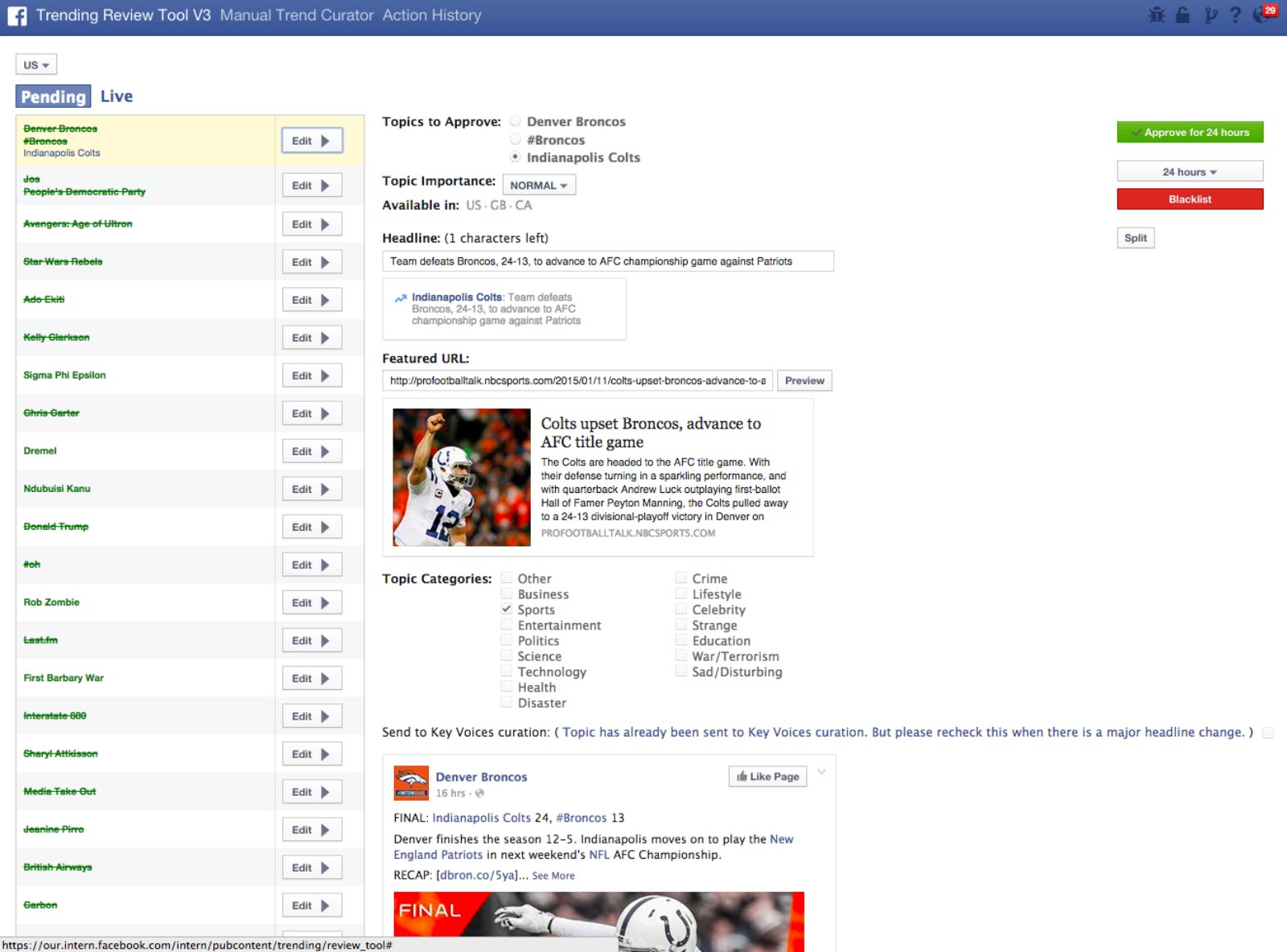

Les lignes directrices du document font état d’une intervention humaine qui se manifeste essentiellement à chaque étape d’évaluation d’un sujet d’actualité. On y explique comment injecter un sujet dans le module des contenus populaires, et comment censurer un sujet selon divers motifs dont «ne représente pas un véritable événement», à la discrétion de l’équipe éditoriale.

Les sujets pouvant être injectés sur cette liste doivent toutefois inévitablement avoir été soulevés par l’un de deux algorithmes. Pour alimenter la section Trending Topics, Facebook exploite deux outils : le Review Tool, l’outil principal alimenté par un algorithme en version finale, et le Demo Tool, un outil secondaire dont le nom laisse croire qu’il est alimenté par un algorithme toujours en expérimentation ou en développement.

Afin de déterminer le niveau d’importance d’une nouvelle, le curateur doit valider que celle-ci a été traitée parmi les médias suivants : BBC News, CNN, Fox News, The Guardian, NBC News, The New York Times, USA Today, The Wall Street Journal, Washington Post, Yahoo News ou Yahoo.

Lorsqu’un sujet se retrouve en première page d’au moins 5 de ces sources, il droit être qualifié de National Story. Lorsqu’un sujet est traité en première page de 5 à 7 reprises par l’ensemble de ces médias à l’intérieur d’une semaine, le sujet devient alors un Major Story. Parmi les exemples cités, on mentionne la tragédie de Charlie Hebdo et la décision du jury de ne pas inculper Darren Wilson, le policier ayant abattu Michæl Brown dans le cadre des manifestations de Ferguson.

Nous qualifions cette nouvelle de «Major Story»

Il va de soi que cette fuite est susceptible d’alimenter les critiques à l’égard d’un potentiel agenda caché de la part de Facebook de masquer ou réduire l’importance de nouvelles issues des médias plus conservateurs. Le document remet également en question les propos de Tom Stocky, vice-président responsable de la recherche chez Facebook, qui a déclaré cette semaine :

«Nous n’insérons aucun sujet de manière artificielle dans la section Trending Topic, et nous ne demandons pas non plus à nos modérateurs de le faire.»

Reste à savoir si le fait d’injecter un sujet d’abord soulevé par l’un de ses deux algorithmes doit être considéré comme «une intervention artificielle».

The Guardian a également reçu les témoignages d’anciens employés de Facebook ayant travaillé sur la gestion des actualités qui nient les allégations d’une quelconque partisanerie manifestée par l’entreprise. Selon eux, l’ajout du facteur humain dans l’évaluation des tendances est bénéfique, puisque l’algorithme à lui seul n’est pas suffisamment précis pour soulever les sujets les plus pertinents.